4La sera del 7 del mese,Intel rilascia ufficialmente la terza generazione di processori scalabili Xeon,Cioè, Ice Lake-SP di cui parla da molto tempo,Questo è il primo processore di data center di processo da 10 nm di Intel,Questo processore ha fino a 40 core,Miglioramento significativo delle prestazioni rispetto ai prodotti di generazione precedente,I carichi di lavoro popolari di data center sono stati ridotti del 46% in media,Il nuovo processore migliora anche la funzionalità della piattaforma,La terza generazione di Xeon Scalable Processor è il primo processore di data center a dual-slot mainstream di Intel con tecnologia di espansione di protezione software SGX abilitata,Ci sono anche accelerazioni cripto e funzionalità di boost DL per l'accelerazione dell'IA。

I processori Scalable Intel Xeon sono progettati per i fornitori di cloud computing e altre società che eseguono data center su larga scala,In effetti, ha iniziato la spedizione agli utenti per test e distribuzione prima del rilascio,Nei primi mesi del 2021,Intel ha spedito più di 200.000,È previsto per accelerare le spedizioni in futuro。Tutti i principali fornitori di servizi cloud prevedono di distribuire i servizi di Ice Lake,Lanceranno tali servizi per la prima volta ad aprile。Intel ha oltre 50 oem eccellenti、Si prevede che ODM lancerà oltre 250 progetti basati su Ice Lake sul mercato。

La terza generazione di processore scalabile Xeon include effettivamente due parti,Uno è il lago Ice-SP della piattaforma Whitley,Solo singolo o doppio,Aggiornamento del core della CPU a Sunny Cove Micro Architecture,Rispetto alle varie microarchitezioni derivate originali basate su Skylake,Sunny Cove ha apportato grandi miglioramenti in IPC。La quarta e ottava rotta sono esclusive per Cooper Lake rilasciate non molto tempo fa,In realtà è un derivato di Skylake da 14 nm。

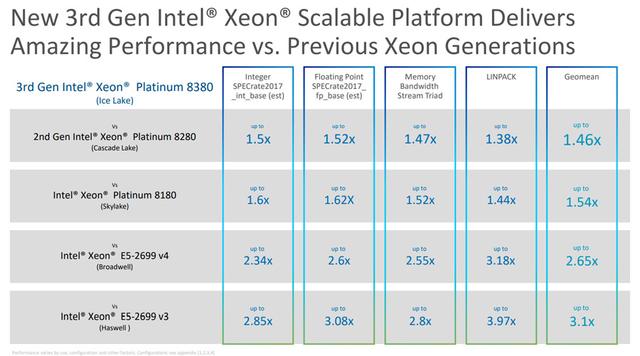

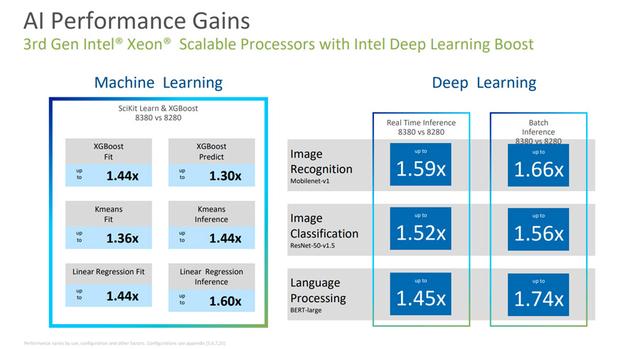

Ice Lake-SP rispetto alla generazione precedente di Cascade Lake,Il numero massimo di core è aumentato da 28 a 40,IPC è aumentato del 20%,Le prestazioni complessive sono migliorate del 46%,Le prestazioni di AI sono state migliorate del 74%,Rispetto al sistema cinque anni fa,Miglioramento delle prestazioni del 165%。

46%I miglioramenti delle prestazioni si basano su parametri di riferimento standard,In molte applicazioni, in realtà c'è un miglioramento delle prestazioni più del 50%,Incluso il cloud computing、5G、Internet delle cose、HPC、Aree chiave di lavoro come AI,Ciò è principalmente perché l'IA sta diventando sempre più importante nel campo Edge,Il miglioramento delle prestazioni di Ice Lake-SP a questo proposito è molto ovvio。

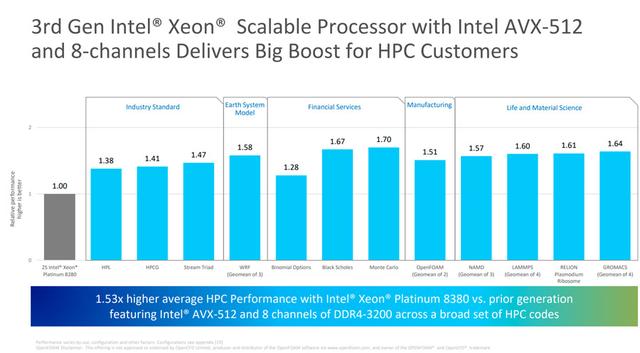

Il numero di nuclei del processore scalabile Xeon di terza generazione parte da 8 core,Fino a 40 armi nucleari,Rispetto alla generazione precedente da 4 a 28 core, ha un aumento significativo,Anche l'architettura e la capacità della cache sono aumentate a causa dell'aggiornamento dell'architettura。In termini di memoria, aggiornato dalla generazione precedente di DDR4-2933 a 6 canali a DDR4-3200 a 8 canali,Il contenuto massimo è sempre stato aumentato da 3 TB a 4 TB,Anche la massima capacità della memoria persistente di Optane è aumentata da 1,5 TB a 2 TB。Versione PCI-E aggiornata da 3.0 a 4,0,64 canali PCI-E 4.0 sono ora disponibili per slot。Ci sono ancora da 2 a 3 canali UPI,Tuttavia, la velocità per canale è stata aumentata da 10,4 GT/s a 11,2GT/s,Inoltre, ci sono una serie di aggiornamenti impostati per le istruzioni。

Ice Lake-SP rispetto al lago Cascade,La dimensione del buffer di riordino fuori ordine è stata ampliata da 224 a 384,La cache dei dati di livello 1 è aumentata da 32kb a 48kb,La cache di livello 2 è aumentata da 1 MB a 1,25 MB,Il backend introduce una seconda unità FMA,In questo modo, ci sono due unità FMA+One FMA512 ordinarie。

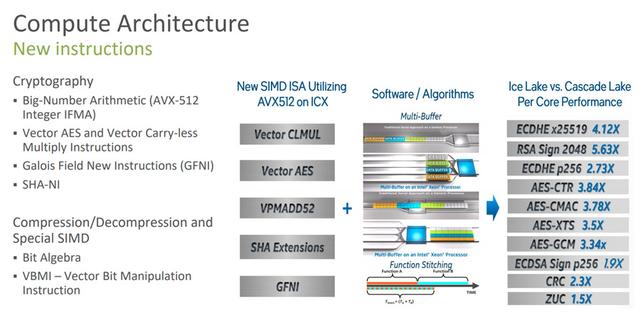

Il nuovo kernel sta arrivando con un nuovo set di istruzioni,Attraverso un set di istruzioni dedicate,Le prestazioni di Ice Lake-SP in molti calcoli di crittografia e decrittazione sono molto più elevate di quelle del lago Cascade.,Il più esagerato è 5,63 volte。Ma se vuoi goderti l'aumento delle prestazioni,Il software deve essere ricompilato per il nuovo set di istruzioni。

La terza generazione di Xeon Scalable Processor porta VAES、set di istruzioni VPCLMULQDQ,E Pci-e 4.0、Nuove funzionalità come DDIO,Rispetto alla generazione precedente,Miglioramenti delle prestazioni medie in una gamma di carichi di lavoro di rete ampiamente distribuiti 1.62x。

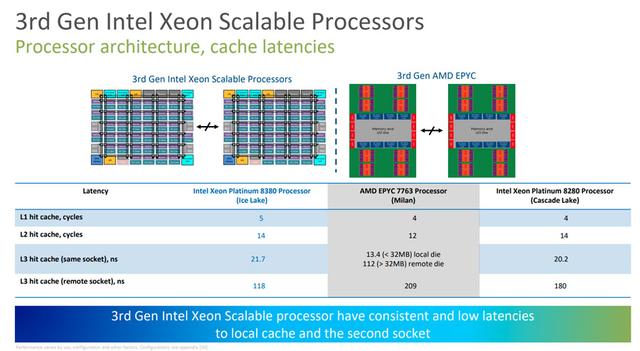

I ritardi nella cache L1 e L2 del processore scalabile Xeon di terza generazione sono in realtà solo un po 'più alti di quelli dei concorrenti.,Tuttavia, in termini di cache L3, l'ultima generazione di Epyc Milan è ancora composta da uno IOD e più CCD.,L3 Latenza della cache nello stesso dado è molto basso,Ma la latenza è molto elevata quando si accede alla cache L3 di altri Die,Il processore scalabile Xeon di terza generazione è un grande chip,Quindi la latenza della cache L3 è molto stabile,Inoltre, il ritardo della cache L3 di accedere a un'altra CPU socket è molto più basso di quello di EPYC.,Rispetto alla generazione precedente dei nostri prodotti, è stato anche ridotto molto。

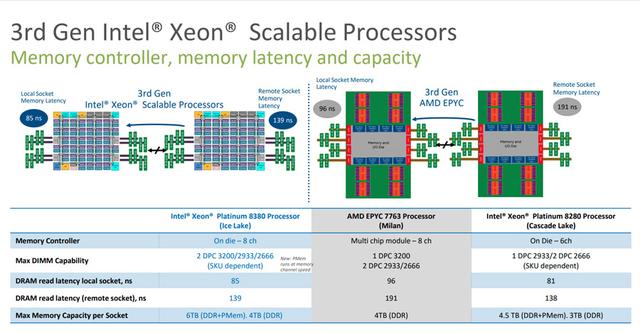

Aspetto della memoria,La terza generazione di processore scalabile Xeon è stata aggiornata a 8 canali,La frequenza di memoria è stata anche aggiornata da DDR4-2933 a DDR4-3200,E ora, i due slot di memoria in ciascun canale possono mantenere la frequenza a 3200 MHz.,Con rivale Epyc Milan Single Slot 3200MHz,Dual Slot 2933MHz è in realtà più vantaggioso。In termini di latenza della memoria, a causa dell'aumento del numero di canali, la latenza è leggermente migliorata rispetto alla generazione precedente.,Ma è ancora molto più basso dell'avversario。In termini di capacità, la massima capacità di tutti è 4 TB,Ma il processore Scalable Xeon può installare 2 TB di memoria di lunga durata di Optane,Non c'è avversario al riguardo。

Perché il processore scalabile Xeon di terza generazione supporta di più nel set di istruzioni,Quindi anche se il numero di nuclei è in svantaggio,Ma può ancora guidare l'avversario in più campi,Ad esempio, supporta il calcolo ad alte prestazioni con AVX-512、crittografia、E applicazioni AI che supportano DL Boost。

Oltre alla terza generazione di processori scalabili Xeon,Intel ha anche lanciato Optane Dureble Memory 200 in questa conferenza、Optane SSD P5800X、Intel SSD D5-P5316、Scheda di rete Intel Ethernet 800 Series 100 Gbps、Agilex FPGA e Software del quarttus 20.4 di supporto,Il processore Xeon non è un semplice processore,Intel può anche fornire un set completo di prodotti e servizi di supporto,Questo è anche il motivo per cui il processore Xeon ha così tanto successo。

Da quando Intel ha lanciato il suo primo processore Scalable Xeon nel 2017,Intel ha consegnato oltre 50 milioni di processori scalabili Xeon ai clienti di tutto il mondo,Supporta i data center in tutto il mondo。In meno di dieci anni,Intel ha distribuito oltre 1 miliardo di core xeon,Alimentare la nuvola。E oggi,Secondo le stime di Intel,Più di 800 fornitori di servizi cloud hanno distribuito server in base ai processori scalabili Intel Xeon。

Fonte di contenuto:https://Newsroom.intel.com